让建站和SEO变得简单

让不懂建站的用户快速建站,让会建站的提高建站效率!

据多家巨擘商讨机构最新研判,2026 年 中枢存储供应链的结构性艰难已成行业刚性试验,供需缺口合手续扩大且很可能持续至 2027 年。不仅是存储部件的单点问题,现时,生成式 AI 正从时间尝鲜全面走向限制化落地,大模子时间的驾御场景正在从教练为主转向训推并重和轻量推理,PD 分离、KV Cache 等时间的限制化驾御在合手续普及推理后果的同期,对高带宽、大容量的 GPU 内存提议了极致严苛的条目,显存资源垂危带来的行业慌乱正在合手续蔓延。叠加存储部件供应艰难与价钱跳升的双重压力,AI 产业发展面对严峻的资源与资本挑战,单纯依靠 “力大砖飞” 的硬件堆叠,不仅会大幅推高每 token 资本,更受供应链产能制约难合计继,严重影响产业良性发展。

因此,通过软硬件协同优化普及 GPU 等关键部件的使用后果,成为破解内存供应链艰难慌乱、责难总体领有资本的中枢旅途。

破局窘境·架构解密:新华三打造智算推理新引擎

现时,大模子推理面对的发展窘境已不能隐敝:模子对算力与显存的需求呈指数级增长,关联词堆叠GPU硬件所带来的资本与能效压力,严重制约时间的可合手续发展。尤其在处理长文本、多轮对话等场景时,模子为保存高下文而生成的KV Cache(键值缓存)会急剧膨大,不仅大王人占用贵重的GPU显存,更导致大王人重迭计较,成为制约反馈速率、推高运营资本的瓶颈。

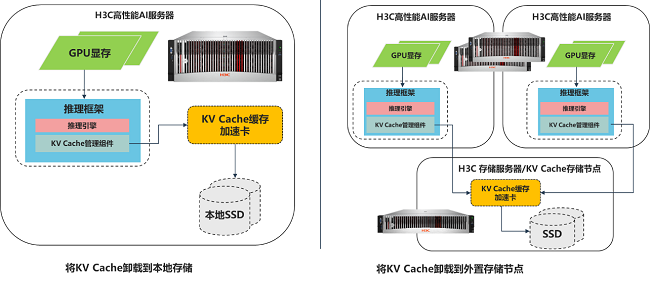

直面资本与后果的核肉痛点,紫光股份旗下新华三集团打造出效力兼备的大模子推理场景加快决议。通过其自研的定制化ASIC芯片提供硬件级加快,将KV Cache从GPU内存卸载到指定存储节点,构建专为AI假想的“下一代内存层”,减弱GPU显存的压力,从而在系统层面达成了存算资源的新均衡。新华三凭借自己巨大的硬件集成与全栈优化智商,驱动业内前沿科技与自研AI作事器的鼎新耦合,经过深度的测试调优最终造成了大模子推理加快的最好践诺,为业界提供了一条性能与资本兼顾的全新推理范式。

从部署样子来看,本决议既维持单机样子部署,平直提高单台AI作事器的推感性能。也维持通过外置存储节点的面孔同期对接多台AI作事器,提高集群的推感性能。

实教练证·性能跃升:中枢筹算翻倍,推升深度推理新速率

为深切探讨本决议中KV Cache卸载对推感性能的普及,新华三基于自研高性能AI作事器进行基准测试,重心和蔼在吞并机型上,启动DeepSeek-V3-671B模子时,遴荐标准推理作事和遴荐KV Cache卸载加快决议的两种模式下的性能各异,辩认构建10K和30K的文本输入,模拟骨子驾御场景中的多轮对话推理历程,以确保测试收尾具有骨子参考价值。经多轮考据,遴荐KV Cache卸载加快决议的推理中枢筹算权臣优化:

• 并发用户数普及200%:在交流TPOT(每个Token生成的平均延伸,ms)截至下,不异的算力资源可维持的并发数权臣普及,保险用户体验的同期维持作事更多的用户。

• 推理延伸大幅责难:TTFT(首Token生成的延伸,ms)责难70%,TPOT(每个Token生成的平均延伸,ms)责难30%,大幅裁减反馈延伸,普及用户体验。

场景适配·全域阴私:贴合企业GenAI落地需求

• 交互式驾御(多轮对话): 如聊天机器东说念主、智能客服等。这类驾御中,用户与模子的交互是多轮的,后续轮次的输入往往依赖于前序对话的高下文。通过快速加载存储历史 KV Cache,大约大幅裁减反馈延伸,普及用户体验。

• 长高下文处理: 关于需要处理数千甚而数万Tokens高下文的任务(如长文档问答、代码生成、复杂领导明白),GPU内存容量往往成为瓶颈。本决议提供的PB级KV Cache扩展智商,使得处理这类长高下文任务更为安谧,幸免了因GPU内存不及导致的性能下落或任务失败。

• 高并发推理作事: 在面向大王人用户的在线推理作事中,系统需要同期处理多个并发肯求。本决议通过高效的KV Cache惩处,大约维持更多并发会话,权臣提高系统的举座隐约量(RPS),从而在交流的GPU资源下作事更多用户。

跟着模子限制的扩大和用户基数的扩张,大模子推理后果正成为AI基础要害性能的关键筹算。新华三凭借多年来在AI边界的时间鼎新与践诺探索推出推理加快决议,并进行经心的调优践诺,充分考据了该决议在普及推理后果方面的权臣上风,进一步加快GenAI驾御的发展。

GenAI期间,推理加快注定是一条合手续普及、永无至极的鼎新之路。面向以前,新华三将合手续在AI Infra边界深耕,提供更多针对不同场景,假想基于不同加快层级、不同加快介质等时间路子的推理加快决议,匡助企业和建树者更圣洁地粗放大模子落地驾御的复杂性和限制挑战,鼓动AI时间在更多边界的驾御和鼎新。

实盘配资平台可靠吗_股票配资实测分析提示:本文来自互联网,不代表本网站观点。